類人速度超快語音響應!OpenAI推出新旗艦模型GPT-4o,圖文音頻手機AI搞定

來源:硬AI

雖然沒有帶來備受期待的人工智能(AI)搜索引擎,但OpenAI在主打產品AI模型上花了更多心思,拓展多模態功能,讓用戶可以免費玩轉文字、圖片和語音輸入。

美東時間5月13日週一,OpenAI首席技術官Mira Murati在直播演示中宣佈,推出新的OpenAI旗艦AI模型,名爲GPT-4o,稱它面向所有人,包括免費用戶,爲“我們的免費用戶帶來GPT-4級的智能”。OpenAI還推出了臺式機版本的ChatGPT以及新的用戶界面(UI)。

Murati說:“這是我們第一次在便於使用方面真正邁出一大步。” 她評價,GPT-4o的“速度快得多”,提升了GPT-4在文本、視頻和音頻方面的功能,“GPT-4o 通過語音、文本和視覺進行推理”。

Murati在演示中稱,相比GPT-4 Turbo,GPT-4o的速度快了兩倍,成本降低了50%,API速率限制、即用戶可發出的請求數量提高了五倍。有網友在社交媒體X上對此感到開心,稱API終於改進了。

實時求解方程、做口譯、分析圖表、讀取用戶情緒

GPT-4之前已經可以分析圖像和文本,完成從圖像中提取文本、以文本描述圖像內容這類任務。GPT-4o則是增加了語音功能。Murati 強調了GPT-4o在實時語音和音頻功能方面必要的安全性,稱OpenAI將繼續部署迭代,帶來所有的功能。

在演示中,OpenAI 研究主管 Mark Chen掏出手機打開ChatGPT,用語音模式Voice Mode現場演示,向GPT-4o支持的ChatGPT徵詢建議。GPT的聲音聽起來像一位美國女性,當它聽到Chen過度呼氣時,它似乎從中察覺到了他的緊張。 然後說“Mark,你不是吸塵器”,告訴Chen要放鬆呼吸。如果有些大變化,用戶可以中斷GPT, GPT-4o的延遲通常應該不會超過兩三秒。

另一項演示中,OpenAI的後訓練團隊負責人Barret Zoph在白板上寫了一個方程式3x+1=4,ChatGPT給他提示,引導他完成每一步解答,識別他的書寫結果,幫助他解出了X的值。這個過程中,GPT充當了實時的數學老師。GPT能夠識別數學符號,甚至是一個心形。

應社交媒體X的用戶請求,Murati現場對ChatGPT說起了意大利語。GPT則將她的話翻譯成英語,轉告Zoph和Chen。聽完Murati說的意大利語,GPT翻譯爲英文告訴Chen:“Mark,她(Murati)想知道鯨魚會不會說話,它們會告訴我們什麼?”

OpenAI 稱,GPT-4o還可以檢測人的情緒。在演示中,Zoph將手機舉到自己面前正對着臉,要求ChatGPT告訴他自己長什麼樣子。最初,GPT參考了他之前分享的一張照片,將他識別爲“木質表面”。經過第二次嘗試,GPT給出了更好的答案。

GPT注意到了Zoph臉上的微笑,對他說:“看起來你感覺非常快樂,喜笑顏開。”

有評論稱,這個演示顯示,ChatGPT可以讀取人類的情緒,但讀取還有一點困難。

OpenAI的高管表示,GPT-4o可以與代碼庫交互,並展示了它根據一些數據分析圖表,根據看到的內容對一張全球氣溫圖得出一些結論。

OpenAI稱,基於GPT-4o的ChatGPT文本和圖像輸入功能將於本週一上線,語音和視頻選項將在未來幾周內推出。

X平臺的網友注意到了OpenAI展示的新功能。有網友指出,GPT-4o不僅可以將語音轉換爲文本,還可以理解和標記音頻的其他特徵,例如呼吸和情感,不確定這在模型響應中是如何表達的。

有網友指出,根據演示,ChatGPT的語音能幫助實時求解方程,像人類一樣說話,而且幾乎是即時響應,全部都在手機上運行。

最快232毫秒響應音頻輸入 平均響應時間和人類相似

OpenAI官網介紹,GPT-4o中的o代表意爲全能的前綴omni,稱它向更自然的人機交互邁進了一步,因爲它接受文本、音頻和圖像的任意組合作爲輸入內容,並生成文本、音頻和圖像的任意組合輸出內容。

除了API的速度更快、成本大幅下降,OpenAI還提到,GPT-4o可以在最快232毫秒的時間內響應音頻輸入,平均響應時間爲320毫秒,這與人類在對話中的響應時間相似。它在英語文本和代碼方面的性能與GPT-4 Turbo 的性能一致,並且在非英語文本方面的性能有了顯著提高。

OpenAI介紹,與現有模型相比,GPT-4o 在視覺和音頻理解方面尤其出色。以前GPT-3.5和GPT-4用戶以語音模式Voice Mode與ChatGPT 對話的平均延遲時間爲2.8 秒和 5.4 秒,因爲OpenAI用了三個獨立的模型實現這類對話:一個模型將音頻轉錄爲文本,一個模型接收並輸出文本,再有一個模型將該文本轉換回音頻。這個過程意味着,GPT丟失了大量信息,它無法直接觀察音調、多個說話者或背景噪音,也無法輸出笑聲、歌唱或表達情感。

而GPT-4o的語音對話是OpenAI跨文本、視覺和音頻端到端訓練一個新模型的產物,這意味着所有輸入和輸出都由同一神經網絡處理。OpenAI稱,GPT-4o 是其第一個結合所有這些模式的模型,因此仍然只是淺嘗輒止地探索該模型的功能及其侷限性。

上週曾有消息稱,OpenAI將發佈基於AI的搜索產品,但上週五OpenAI的CEO Sam Altman否認了該消息,稱本週一演示的既不是GPT-5,也不是搜索引擎。這意味着OpenAI再一次沒有像市場爆料的時間線那樣推出AI搜索。此後有媒體稱,OpenAI的新產品可能是一個具備視覺和聽覺功能的全新多模態AI模型,且具有比目前聊天機器人更好的邏輯推理能力。

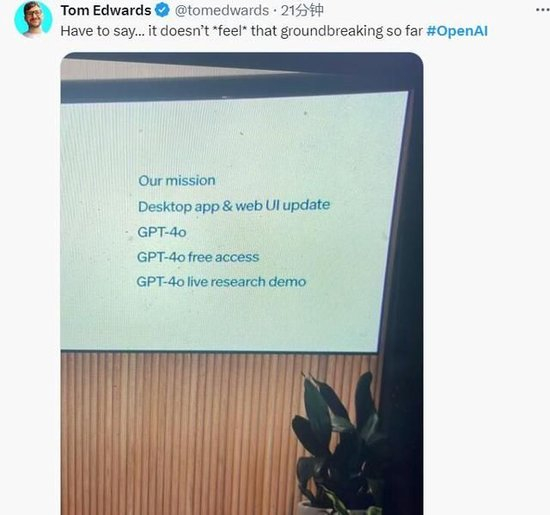

本週一的演示的確展示了OpenAI在語音方面的努力。對於OpenAI推出的新模型和UI更新,有網友稱,感覺到目前爲止OpenAI沒有那麼開創性。

也有網友覺得OpenAI進一步拉開了和蘋果的差距,還發了一張人滿頭大汗的動圖,稱現在蘋果的語音助手Siri應該是這個樣子。