专访Apple软件副总裁:关于iPhone 12系列影像系统的对话

本文来自@flypig

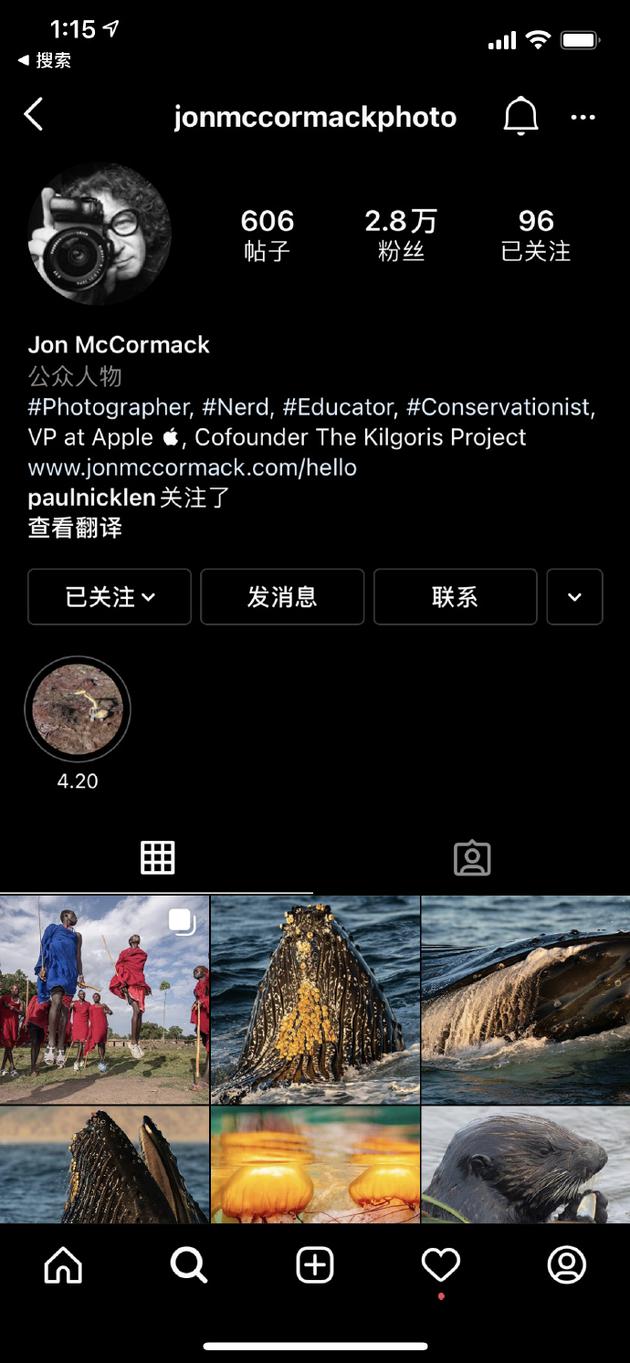

Jon McCormack 是位很有趣的摄影师。他的 Instgram 页面上 (/jonmccormackphoto)充满了人文和风光摄影作品——加州的鲸、南极的冰川、肯尼亚的原住民。从头像看,他常用的机身是 SONY 全画幅数码相机,转接 Leica 的 Elmarit-M 24mm F/2.8 ASPH 镜头。他是资深的器材党。

不拿照相机的时候,他在 Apple 担任软件副总裁。他的重要工作:进一步提升 iPhone 的影像系统。

在测试了 iPhone 12 和 12 Pro 之后,我对影像系统中的改进大感兴奋,计算摄影的加成功不可没,同时,我也产生了不少疑问。在和 Jon McCormack 的越洋电话中,他进行了尽可能详尽的回答。

- 我们在今年的 iPhone 发布会上听到了很多次‘计算摄影’(computational photography)。您是 Apple 负责软件的副总裁,又是一个优秀的人文摄影师。您如何看待‘计算’和‘摄影’之间的关系?

在过去,我们要创作出画质更好的照片,只能在‘拍摄’这个环节去提升硬件。我们买非常非常大的胶片——大画幅相机的底片真的很大一张,安装起来也很麻烦——去买非常非常贵的镜头,去手动控制景深和曝光,慎重地按下快门。

但是我们现在用的 iPhone,镜头只有这么小,感光元件也只有指甲盖大。那么我们如何找回模拟时代的体验?我们要靠‘计算’,让手机做很多的数学题,通过各个传感器——比如最新加入的 LiDAR——获得的信息,让手机自动完成过去‘数码暗房’里手动完成的工作。

- 那么,‘打赢专业的单反和电影机’是你们的目标吗?

这不是我们的思维方式。

我们在 iPhone 12 的样片拍摄过程中,能把摄制团队压缩到非常小,只有几个人就完成了样片拍摄。过去,你要拍摄这样的镜头,要很多人,有的人扛机器,有的人测光,有的人对焦,有的人操作电影机。这种变化,才是我们工作的核心。

我们的目标是让每个人都能讲述自己的故事,而且让每个人都能用到最好的科技——比如‘杜比视界’。他们可以从口袋里掏出一台小巧的手机,拍下身边温馨的画面,完成编辑,再分享出去,整个流程里都是‘杜比视界 HDR’的视频。这种体验非常美妙。

- 但现在的手机视频,似乎还不像手机拍照片那样,在‘计算摄影’上达到很高的完成度。这里面的瓶颈是什么?

拍摄视频和拍摄照片还不太一样。在拍摄照片的时候,手机有足够的时间,去做后置的计算处理。但是在拍摄视频的时候,一秒有 30 帧甚至 60 帧,需要完成的计算任务就非常多了。

在过去的几年时间里,手机视频的中间影调的成像质量已经被解决得很好,大家的水平都差不多。

那么,挑战主要集中在阴影和高光。你注意观察的话,今年 iPhone 在画面暗部的噪声已经少了很多,画面干净了很多。另外,我们今年将视频的色深从 8 比特提升到了 10 比特。我们利用多记录的这些色彩信息,也对高光做了更好的还原。

还有,我们今年在延时摄影里也加入了‘夜景模式’。这其实是视频的范畴,不是拍摄静态照片。这和照片的‘夜景模式’其实是两套不同的代码,因为拍视频需要更快的处理。照片和视频的‘夜景模式’里,共享了很多计算逻辑和知识,但本质上还是非常不同。

- 你觉得现在手机感光元件的实际动态范围,能够喂饱 HDR 视频所能承载的动态范围吗?

手机视频的改良是一条非常漫长的道路。A14 这个芯片,里面加入了大量对 HDR 视频拍摄能力的优化。它的神经网络引擎速度提升了 80%,它提供了很强的多帧融合(fusion)能力。你将 iPhone 12 Pro 的视频和上一代相比,已经有了长足的进步。

而在未来,你会看到更多这方面的提升。

- 我看现在 iPhone 的‘杜比视界 HDR’视频,传到电脑上以后是 HLG 曲线。这和我们过去处理的‘杜比视界’素材——它们都采用了记录绝对亮度值的 PQ 曲线——好像不太一样。为什么这么做?

在 iPhone 内部,这是一个完整的‘杜比视界’拍摄流程。这是一个全新的 8.4 版本的标准。我们和杜比进行了很深入的合作,这个标准将会得到更大范围的应用,将会有更多的设备从中受益。

你看到的 HLG 曲线是为了更好的兼容性。我们希望这个导出的视频文件,能够在各种各样的设备和屏幕上观看,而 HLG 曲线满足了这个需求。

- 我看现在的 HDR 视频,如果直接从手机传到社交网络上,颜色有点偏差。这个兼容性问题如何解决?

在 iPhone 内部的视频流程里,我们保存了两套 metadata,一套对应于 HDR,一套对应 SDR。

随着 iPhone 12 和 12 Pro 的上市,我们将会推送新的 iOS 版本,到时候会有新增加的 API,让 app 告诉系统,他们是否支持杜比视界 HDR 视频,这样系统就会上传正确动态范围的版本。

- 今年的 HDR 照片,我看好像和去年的 HDR 视频不太一样。似乎高光更亮了?是这样吗?

相比于 iPhone 11 Pro 拍摄的 HDR 照片,我们今年在存储下来的照片文件里面,还增加了一个‘高光导图’(Highlight Map)。

这样可以充分利用我们今年推出的 Super Retina XDR Display 来展现出更高两档的高光,让用户直接在手机屏幕上看到更大的动态范围。这也是为什么,你在手机上看你拍的蓝天白云,会觉得云比过去的手机上更亮了一些。

- 谢谢。

采访者注:

在测试过程中,我们看到,使用 iPhone 12 系列拍摄的视频,HDR format 是‘Dolby Vision, Version 1.0, dvhe.08.04, BL+RPU, HLG compatible’。

在‘dvhe.08.04’字符串中,‘dvhe’指杜比视界高性能压缩视频(Dolby Vision High Efficiency)。根据白皮书《Dolby Vision Profiles and Levels Version 1.3.2》的信息,‘08’指 profile 版本为 8,‘04’指 level 为 1920 x 1080 @ 30。

Profile 8 的编码为‘10-bit HEVC’,信号兼容性为‘1, 2, or 4’,既 HDR10、SDR 及一种‘在特定的广播和移动设备’上工作和‘为了某些特定设备优化’的标准。(引用自杜比在 2019 年 9 月 16 日发布的公开资料。)

‘BL+RPU’指‘base layer + reference picture unit’。我们猜测, iPhone 拍摄的 HDR 视频可能在 HLG 曲线之外,为回放设备提供了正确解析 SDR 和 HDR 色彩的参考信息(RPU),将 HLG 曲线记录的色彩进行再次解析——既是 Jon McCormack 所说的‘两套元数据’。

实际上在 iPhone 12 录制的视频里,存在三套元数据。我们暂时无法知晓各自对应的用途。

截止发稿时为止,搜索不到更多的关于‘Dolby Vision Profile 8.4’和 iOS、macOS、tvOS 上关于‘杜比视界新 API’的资料。