蔚來事故引發自動駕駛信任危機

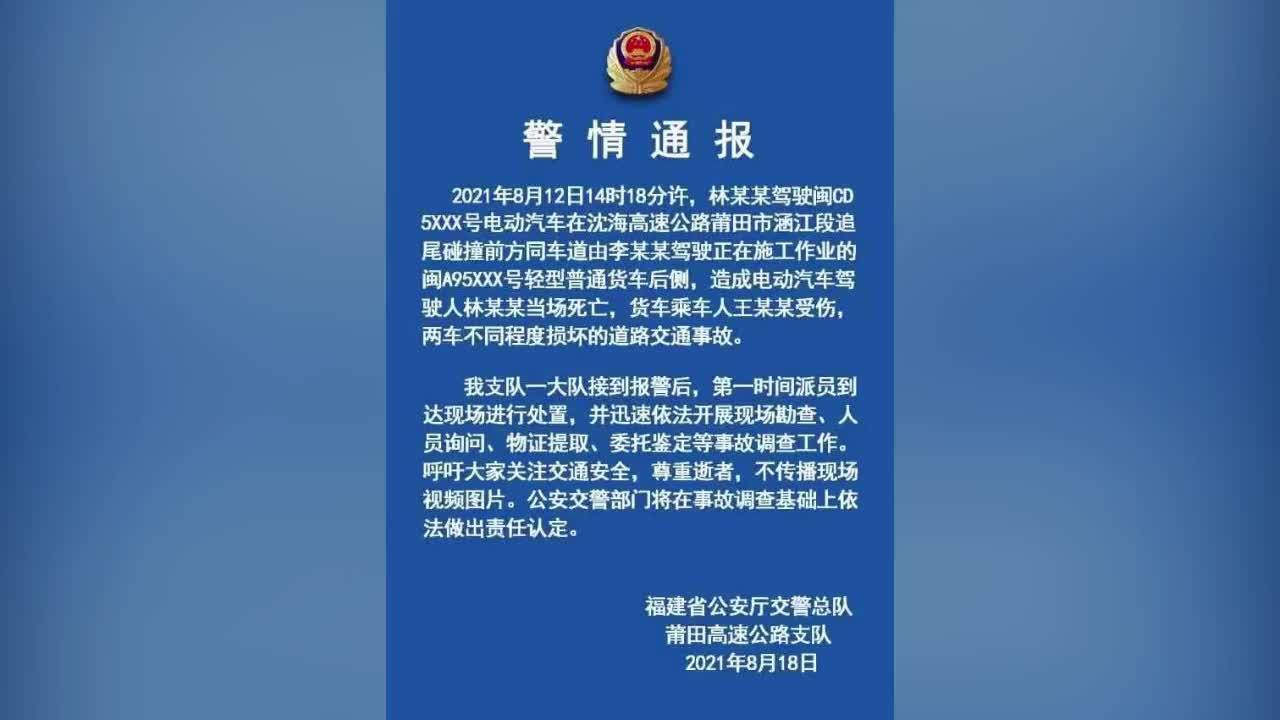

福建莆田交警通報蔚來自動駕駛車禍事件:已開展調查,將依法做出責任認定

福建莆田交警通報蔚來自動駕駛車禍事件:已開展調查,將依法做出責任認定

歡迎關注“新浪科技”的微信訂閱號:techsina

文/趙健

來源:甲子光年(ID:jazzyear)

用戶對系統的充分信任有可能會釀成大禍。

蔚來汽車L2級輔助駕駛車禍致死事件,將自動駕駛推到了風口浪尖。

8月12日,餐飲創業者林文欽在瀋海高速涵江段發生交通事故離世。事故發生時,其駕駛的蔚來ES8汽車處於啓用NOP(領航輔助駕駛系統)狀態。圍繞NOP的安全性引發巨大爭議,截至目前,案件還在調查之中。

威馬汽車創始人沈暉在微博上關於“爲何輔助駕駛普及但事故頻發”發表了個人看法:

L2級別輔助駕駛功能,駕駛員功能操作主體,也是責任主體。

L4以上級別自動駕駛功能,車內無人狀態下,操作主體是車輛本身,責任主體當歸主機廠。

這兩條其實算一個科普。美國機動車工程師學會(Society of Automotive Engineers,簡稱SAE)曾對自動駕駛做了6個分級,包括“駕駛員支持系統(國內一般稱爲輔助駕駛系統,範圍爲L0~L2)”和“自動駕駛系統(L3~L5)”,並明確了各個級別自動駕駛的責任主體。去年3月工信部發布《汽車駕駛自動化分級》文件,基本沿用了美國SAE的標準。

但是我們可以從圖中看到,L3的責任主體出現了兩種顏色:明明被歸爲“自動駕駛”級別,但當出現系統能力不足時,需要駕駛員接管。

如何界定系統能力不足?實際操作中往往很難釐清邊界。這在客觀上給車企的營銷宣傳帶來了“操作空間”,比如經常聽到的“L2+”、“L2.5”、“L2.9”等等。還有人乾脆稱,根本就不應該存在“L3”,駕駛員負責的就叫“L2”,機器負責的就叫“L4”。

AutoX創始人肖健雄告訴‘甲子光年’,現在行業有一些錯誤的輿論來混淆概念,比如弄出一個“自動駕駛”,既不是“輔助駕駛”,又不是“無人駕駛”,那什麼是“自動駕駛”?

對此,理想汽車CEO李想就在朋友圈呼籲媒體和行業機構統一自動駕駛中文名稱的標準,“L2和L3什麼的用戶聽不懂,都是專業話術。建議統一名稱:L2=輔助駕駛;L3=自動輔助駕駛;L4=自動駕駛;L5=無人駕駛,一個多餘的中文字也不要有,避免誇張的宣傳造成用戶使用的誤解”。

用戶對系統的充分信任有可能會釀成大禍。7月8日,在世界人工智能大會上,心直口快的前華爲智能駕駛總裁蘇箐評價特斯拉近幾年的高事故率,“機器進入人類社會和人類共生的時候,機器是一定會造成事故率的,講難聽點就是‘殺人’,只是說我們要把它的事故概率降到儘量低。從概率上來說,這就是一件有可能發生的事。”

由於出現了“殺人”的不當言論,蘇箐因言獲罪而被免職,但其言論似乎直戳“皇帝的新衣”。

不僅僅是特斯拉,只要車輛有輔助駕駛功能的車企,都不得不面對可能帶來的安全風險。這不僅關乎車企自身,也關乎整個行業的發展。

1、自動駕駛真的安全嗎?

雖然事故頻發,但業內一般認爲自動駕駛的“AI司機”依然比人類司機更安全。

去年文遠知行創始人兼CEO韓旭作客甲子直播間做過一次分享。其中韓旭提到,美國交通管理局曾把交通事故的原因總結爲 4個D打頭的英文單詞——Drunk(醉駕)、Drug(毒駕)、Drowsy(疲勞駕駛)和Distracted(分心)。

自動駕駛的意義在於,它的駕駛水平可能不會高得像熟練的賽車手,但它能穩定地維持在一定水平,不會出現人爲駕駛時疲勞、分心等問題。所以總的來說,自動駕駛比人類自主駕駛更安全。

不過也必須承認,當下的自動駕駛水平遠遠比不上老練的司機,更像一個新手或者中等熟練程度的司機。更重要的是,自動駕駛當下還存在很多沒解決的問題,尤其是10%的長尾問題——經常被稱爲Corner Case(極端案例)。

以這次蔚來汽車事故爲例,蔚來的NIO Pilot(NOP)輔助駕駛系統使用了毫米波雷達+攝像頭的組合方案。攝像頭對黃色和白色等與天空顏色比較接近的物體識別率比較低,毫米波雷達本身的成像原理是多普勒效應,對移動物體的識別度比較高,對相對靜止的物體識別度並不高。

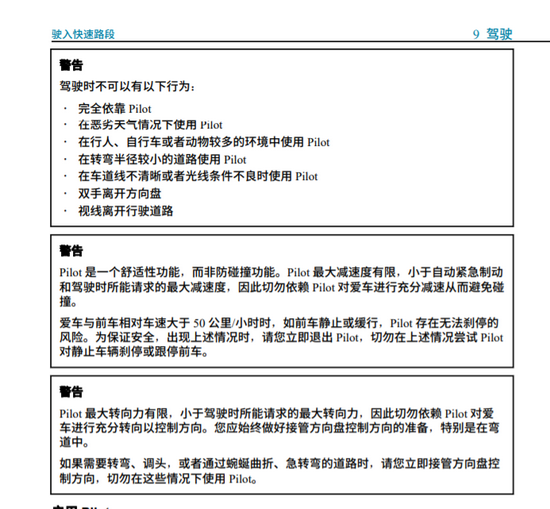

因此,蔚來官方也在NOP的用戶手冊裏明確強調,車輛與前車相對速度大於50公里/小時時,如前車靜止或緩行,Pilot存在無法剎車的風險。

圖片來自蔚來汽車ES8用戶手冊

這是一個行業的普遍現象,包括特斯拉在內的所有車企,目前的高階駕駛輔助系統對於相對靜態的障礙物、雪糕筒在內的物體,識別起來都是一個難題。

這意味着,在沒有完全解決Corner Case的情況下,自動駕駛就依然需要有駕駛員介入。

然而在現實中,自動駕駛技術被當成核心賣點已經成爲車企的重要營銷手段。特別是在一線銷售過程中,銷售往往會誇大車輛的自動駕駛功能。除了蔚來,去年至今國內主流車企都已推出L3級新車。業內多位人士表示,自動駕駛技術已經被車企過度營銷。

這也是消費者吐槽的一點:買之前自動駕駛,出事故輔助駕駛。

提到類似的過度宣傳,就不得不提特斯拉。今年1月特斯拉CEO馬斯克在財報電話會議上表示:“非常有信心在年底前,讓特斯拉有超過人類的可靠自動駕駛能力。”而在今年5月,特斯拉的法律顧問就被“打臉”了,他表示特斯拉的自動駕駛仍然處於L2級別,需要人類駕駛員的監督。

2016年1月20日,在京港澳高速河北邯鄲路段發生了中國首例、也是全球首例特斯拉自動駕駛致死事故。一輛特斯拉直接撞上一輛正在作業的道路清掃車,司機高雅寧當場身亡。後來經交警認定,司機負主要責任。

後來,其家屬以“宣傳誤導”的名義將特斯拉告上法庭。直到今天,此案件仍未判決。

2、“拿命跑數據”?

圍繞安全性引發的自動駕駛路線之爭,行業也一直沒有定論。

根據Business Insider的報道,2013年,在谷歌的自動駕駛部門被分拆成Waymo之前,該部門正在研發一種自動駕駛系統“Auto Pilot”,並徵集了一部分員工進行內部測試。

谷歌告訴參與測試的員工,在車上不能分神,注意力必須放在駕駛上,如果車內的攝像頭髮現他們沒有嚴格遵守這個規定,就會收回車輛。

但谷歌發現一些員工並沒有遵循這些指示,並且有一位員工直接在車上睡着了——他睡着的時候,車輛正以每小時55英里的速度在路上飛奔。

在這件事發生以後,谷歌就徹底關閉了Auto Pilot這個項目,並開始專心研發L4級別的無人駕駛技術。

此後自動駕駛逐漸形成了兩類派別:一是以特斯拉爲代表的漸進式路線或者量產路線,從低階的L2做到高階的L5,這一派以車企爲主;另一派則是谷歌旗下Waymo爲代表的跨越式路線,從一開始就衝向高階自動駕駛,目標就是拿掉司機,比如常見的Robotaxi、L4級Robotruck等。

今年,Waymo高管層震動,包括CEO、CFO在內的8名高管先後離開公司。在商業化難以落地的現實下,跨越式路線似乎遇到了一些困難。

但是,漸進式路線一直以來也遭受爭議,其中與消費者切身相關的就是“拿命跑數據”。

《紐約雜誌》曾報道稱,OTTO(被Uber收購的自動駕駛卡車公司)創始人、曾擔任谷歌自動駕駛汽車項目負責人之一的萊萬多夫斯曾向Uber的工程師們表示:“第一起自動駕駛致死案例不是我們引發的,我有點生氣!”不過,萊萬多斯基否認了上述說法。

一位基金投資人告訴‘甲子光年’:“算法的升級需要數據。如果是在封閉道路測試,永遠會有碰不到的Corner Case,也就永遠缺乏相關數據;而到了公開道路,長尾事故會採集相關數據,而代價就是人命。”

2018年有一位在北京市區駕駛,因“毫米波雷達無法識別靜態障礙物”而致前車追尾的特斯拉車主曾怒斥:你讓我們拿命幫你跑數據嗎?

正是由於數據的稀缺性,也有自動駕駛公司將漸進式路線和跨越式路線進行了融合,代表企業爲Momenta和百度。

以Momenta爲例,採取了“兩條腿”走路的路線:一是MPilot產品線(可對比蔚來的NIO Pilot),將其賣給車企或Tier 1(一級供應商),提供泊車、高速、城區等場景的自動駕駛功能;二是MSD產品線,通過一套工具鏈來處理MPilot帶來的真實行駛數據,實現L4級自動駕駛。

當然,這條路線也存在一定爭議。韓旭在上文提到的直播中表示:“關於L4級路徑之爭,我堅定認爲L3級漸進到L4級這條路是行不通的。L3級別車輛能幫你在高速等特定道路保持行駛,但L3級的車禍是有很多的,並且責任主體是人。通過L3做L4,就像想通過熟練的加減乘除解決需要用微積分才能解決的問題。加減乘除再熟練,如果不去深入思考極限的概念,永遠不可能解出球表面面積。”

由此看來,自動駕駛的路線之爭還會持續一段時間。

3、法規監管利好第三方服務機構

除了路線之爭,監管也是一個難題。

2020年6月,聯合國歐洲經濟委員會(UNECE)發佈了《ALKS車道自動保持系統條例》(ALKS,自動車道保持系統),這是全球範圍內第一個針對具備L3 級自動駕駛能力量產車型的國際法規,但中國表示暫時不會應用該法規。

上週,工信部印發了《關於加強智能網聯汽車生產企業及產品准入管理的意見》,其中要求:

企業實施在線升級活動前,應當確保汽車產品符合國家法律法規、技術標準及技術規範等相關要求並向工業和信息化部備案,涉及安全、節能、環保、防盜等技術參數變更的應提前向工業和信息化部申報,保證汽車產品生產一致性。未經審批,不得通過在線等軟件升級方式新增或更新汽車自動駕駛功能。

這意味着監管部門開始加強對自動駕駛的管理了。不過,如何監管也會考驗智慧。自動駕駛是一個新興技術,技術的發展速度往往領先於法規。AutoX創始人肖健雄告訴‘甲子光年’:“如果(監管)制定不科學,問題沒解決,還會產生更多問題。”

這不是監管部門第一次針對OTA(Over-the-Air Technology,空中下載技術)出臺文件。去年11月和今年6月,國家市場監督管理總局分別發佈通知,規定需要對產品進行OTA升級的企業,需要向市場監管總局質量發展局備案。

在此之前,國內對汽車軟件發佈前的檢測機制還是一片空白。這有可能導致車企濫用OTA技術,車輛的升級風險不可控,或者車企利用OTA來混淆車輛因質量缺陷必須的召回。

比如,廣汽埃安AION S近日就被曝因未經車主同意實施OTA升級,導致車輛出現充電慢、續航縮水、鎖電等一系列問題。今年6月,大量上汽榮威ERX5車主也曾質疑稱汽車在OTA升級後遭遇了“鎖電”, 造成“產品性能與標定不符”。

本次文件對於車企的具體影響還有待觀察。一位認證爲小鵬汽車集成工程師的知乎網友表示,小鵬汽車內部已經在緊急制定新一版合規的OTA軟件發佈流程。

除了企業需要加強相關測試驗證和檢驗檢測能力建設之外,這也意味着第三方檢測和服務機構會迎來利好。這次《意見》裏明確要求確保汽車產品至少滿足系統失效識別與安全響應、人機交互、數據記錄、過程保障和模擬仿真等測試驗證的要求。

其中,仿真測試是一個對自動駕駛非常重要、又相對複雜的點。

與仿真測試對應的是真實路測,輕舟智航市場總監洪澤鑫將仿真測試的優勢總結爲低成本、靈活性、可擴展性和可衡量性。簡單來說,真實路測難以獲得的數據,可以通過仿真測試來模擬。

但仿真測試軟件在國內剛剛起步。知乎認證爲卡爾斯魯厄理工學院機械工程碩士的網友“釐米”總結,主要有三個難點:

一是如何提供一套各大車企都信服的仿真系統。目前市面上主流的仿真功能測試軟件Carmaker,CarSim 事實上自動駕駛測試能力非常弱,很難對自動駕駛系統的性能,尤其是感知層性能做評定。

二是如何對各大車企的技術方案做適配。比如說,對於特斯拉的純視覺技術方案,和國內之後大規模上車的激光雷達方案。二者的仿真系統傳感器模型差別極大,分別適配也有極大的工作量。

三是如何制定一套完善的仿真測試流程。測試場景如何評定?性能邊界在何處?這些都沒有定義。

不論如何,對於消費者而言,更規範的標準、更高的安全性都是一件好事。

而自動駕駛車輛接連發生的事故,對於自動駕駛的急速發展,可能會踩一腳剎車。