人工智能現階段可用“指數級”形容,堪比工業革命

每經記者 鄭雨航 每經編輯 蘭素英

跨國金融服務公司UBS近日發佈了一篇研究報告顯示,各項技術中,“當紅炸子雞”ChatGPT達到全球1億用戶所需時間僅用2個月,而電話用了75年,手機的普及則用了16年。

OpenAI推出的這款聊天式機器人一經問世,便“引爆”全球,成爲熱門話題。而在ChatGPT爆火的背後,則是洶湧的人工智能浪潮。

在今年瑞士達沃斯舉行的世界經濟論壇上,微軟首席執行官薩蒂亞·納德拉(Satya Nadella)與《華爾街日報》主編馬特·默裏(Matt Murray)進行了一場對話,談到了該公司的人工智能業務以及OpenAI的ChatGPT等生成式人工智能工具(AIGC)如何徹底改變我們的工作方式。

在長達30分鐘的座談採訪中,納德拉對ChatGPT的青睞溢於言表,在他看來,人工智能領域的發展在目前這個階段已經可以用“指數級”來形容。

“至少在從事技術工作的30年裏,這是我從沒見過的技術擴散,我也不認爲這種擴散曾發生在工業革命時期。”納德拉強調。“也許這一次,對於知識型工作者來說,這就完全等於工業革命。”

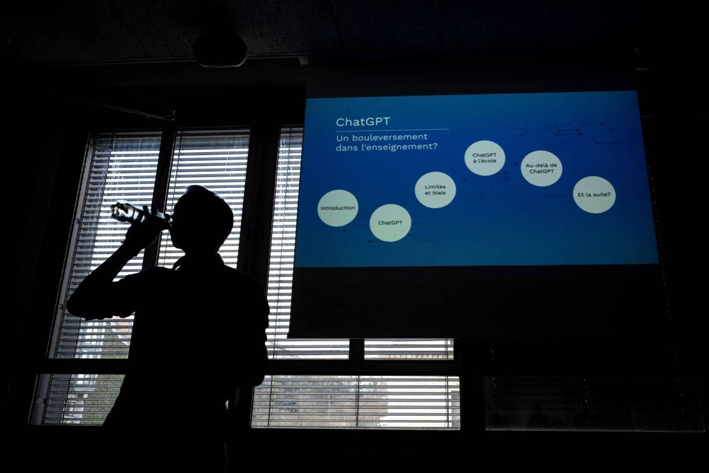

當地時間2023年2月1日,瑞士日內瓦,在公共教育學校媒體服務(SEM)組織的聊天機器人ChatGpt研討會上,教師們坐在筆記本電腦後面 視覺中國圖

談AIGC:堪比工業革命

當地時間2022年12月30日,特斯拉人工智能主管、開發自動駕駛儀的主要領導人安德烈·卡爾帕西(Andrei Karpathy)在推特發文稱,他寫的代碼中有80%是由GitHub Copilot編寫完成的,且準確率約爲80%。GitHub Copilot是一種幫助開發人員編寫代碼的AI工具,歸微軟所有。卡爾帕西表示,Copilot極大地加速了其寫代碼的速度,如今已經很難想象“人工寫代碼”的日子了。

今年的世界經濟論壇期間,《華爾街日報》主編馬特·默裏(Matt Murray)在與納德拉的一場對話中提到,在未來7、8年內,採訪預計將由某種人工智能代替進行,而且採訪可能做得更好,屆時現場不會有記者,取而代之的是機器完成所有的工作。

對此,納德拉並沒有正面評論,而是以上面的例子表明了其立場。“他們(特斯拉工程師)說它的工作效率要高得多,可以說,這(軟件工程師)曾經被認爲是最難自動化的知識工作。”他表示。

此外,納德拉還舉例稱,在印度看到有人使用一種印度白話語言在WhatsApp上與機器人交談,並企圖獲得一些政府計劃。該團隊所做的是使用 GPT 訓練印度政府的所有文檔,並使其能夠以每種印度語言自動化訪問。

“我一生中從未見過,至少在我從事科技行業的30年中,發生在美國西海岸的先進科技在幾個月內就以非常真實的方式出現在印度農村的某個人身上。”納德拉直言。“這是我從未見過的技術擴散。我不認爲它發生在曾經的工業革命中,也許這一次,對於知識型工作者來說,這就完全等於工業革命,這將對每個人都有幫助。”

納德拉所舉的兩個例子,一個是最精英的人工智能開發人員,另一個是印度農村的一個農民,均在積極擁抱人工智能,這足以體現人工智能在世界運轉中的力量。

近日大火的ChatGPT更是讓更多人感受到了人工智能,尤其是AIGC的魅力。

ChatGPT是一種基於GPT-3模型的聊天機器人,不管是生成代碼,回答考試問題,還是寫論文、小說,都不在話下。雖然數學能力之前被網友廣泛吐槽,但1月31日,OpenAI官宣,ChatGPT經過重大更新,已經提升了準確性和直實性,以及數學能力。現在,ChatGPT已經不是那個遇到數學難題就滿嘴跑火車,一本正經胡說八道的ChatGPT了。

超強的學習能力和想象能力讓網友直呼不可思議,有新聞記者甚至感嘆“是不是快失業了”。

納德拉此前曾表示,微軟產品將全線接入ChatGPT,包括搜索引警Bing以及Office“全家桶”。《每日經濟新聞》記者注意到,集成了ChatGPT-4的新版Bing今天曾短暫上線。

新版Bing被描述爲“你身邊的研究助理、個人規劃師和創意夥伴”。它和傳統網絡搜索引擎的第一個主要區別是搜索框,它不是一個搜索欄,而是一個聊天框。它的尺寸要大得多,並且鼓勵使用自然語言而不是關鍵字驅動的搜索詞。你可以讓Bing 查找特定的主題或想法,甚至徵求它的意見,它會在聊天氣泡中回覆你的問題。

談ChatGPT:“幻覺”內容正常

UBS近日發佈了一篇研究報告顯示,各項技術中,ChatGPT達到全球1億用戶所需時間僅用2個月,而電話用了75年,手機的普及則用了16年;而與各項應用相比,TikTok花了9個月達到1億用戶數,Instagram也花了30個月。

然而,從目前的情況來看,說ChatGPT達到“成熟”的標準還爲時過早,也並未實現一個可行的盈利模式。一些批評人士認爲,ChatGPT可能會編寫惡意軟件和網絡釣魚郵件。另外,ChatGPT還可以對文本提示做出虛假的回答,研究人員稱之爲“幻覺”。

昆士蘭大學商學院研究員史蒂夫?洛基博士(Dr。Steve Lockey)在接受《每日經濟新聞》記者的採訪時就曾強調,Chat-GPT或許比谷歌更容易產生“看似很有說服力”的答案。

洛基表示,他曾在學術環境下嘗試研究使用ChatGPT,但是ChatGPT並不擅長提供有參考依據的事實信息。它甚至有時會暗示一些看似可信的參考文獻——例如,ChatGPT會像模像樣地在它給出的答案上寫出作者或出現在某個學術期刊上,然而實際上這些都(作者、期刊等)並不存在。

針對這一問題,納德拉則認爲,“這對人工智能來說並不新鮮,在當今任何其他類別的軟件中也是如此。”他進一步解釋稱,目前對ChatGPT安全的所有擔憂,無論是有害內容還是“幻覺”,只需要通過設計解決。他同時強調,所有的軟件工程都必須考慮模型本身是否安全,然後在其之上建立一個安全系統。

談模型:呈現指數級增長

ChatGPT是微軟多年來與OpenAI深入合作的產物。早在2019年,微軟就向OpenAI投入了10億美元,據華爾街日報報道,微軟正在通過談判再投資100億美元。微軟已經在將這項技術整合到其業務中,納德拉本週宣佈,ChatGPT將很快在微軟的雲計算服務Azure上推出。

“人工智能模型力量正呈指數級增長,而不是線性進展。”納德拉在對話中強調,目前全球經濟停滯、通脹高企,世界需要一些新的東西(指人工智能)來幫助我們。

“如果我們真的夢想着世界上有80億人以上,他們的生活水平應該逐年提高,那麼能夠實現這種夢想的投入是什麼?人工智能可能是我們實現它的方式。我們需要一些真正改變生產率曲線的東西,這樣我們纔能有真正的經濟增長。”他在採訪中解釋稱。

然而,ChatGPT的火爆出圈,讓許多職業人均感受到了不小的壓力。默裏在採訪中表示,對於知識工作者來說,他們已經對未來的工作感受到了焦慮。那麼,人工智能真的能提高我們所有人的生產力,而不是取代我們中的許多人嗎?目前的社會準備好了嗎?

針對這一問題,納德拉給出的答案是,人們需要通過使用這些工具,在工作中獲得更多的影響力。對於來勢洶洶的人工智能浪潮,作爲個人,納德拉認爲最好的準備方法是不要對賭這項技術。

值得注意的是,納德拉在接受完華爾街日報的專訪後三天,即1月19日,據路透社報道,美國微軟公司宣佈,將在2023財年第三季度大規模裁減1萬個工作崗位。據報道,微軟上一次大規模裁員是在2022年7月,而當時也僅僅辭退了近1000名員工。

封面圖片來源:視覺中國