中國方案出爐 全球AI監管升溫

本報記者 秦梟 北京報道

從去年年底由OpenAI研發的ChatGPT引發的AI浪潮,其發展速度超出了所有人的預期,在給人們帶來驚喜之餘,也衍生出數據泄露、電信詐騙、個人隱私風險等問題。爲此,關於AI監管的討論正在全球範圍內升溫。

近日,國家網信辦等七部門聯合發佈《生成式人工智能服務管理暫行辦法》(以下簡稱《辦法》)。此外,聯合國安理會也在近日舉行了一場主題爲“人工智能給國際和平與安全帶來的機遇與風險”的高級別公開會議。這是聯合國安理會首次就人工智能問題舉行會議。

多位業內人士在接受《中國經營報》記者採訪時表示,生成式人工智能服務在監管方面還存在相關法律法規與標準體系不健全、缺乏多部門協同的自上而下的監管體系、監管技術手段落後等突出問題,各國政府和監管機構已開始採取措施加強監管,以確保公衆利益和安全。隨着《辦法》的出臺,標誌着我國AI治理已經走在國際前列。

驚喜與問題同存

從ChatGPT模型連續迭代帶來的技術震撼,到國內外科技巨頭迅速湧入的“百模大戰”, AI儼然成爲當今科技的“必爭之地”。與此同時,AI創業企業們進入新一輪“吸金”熱潮。

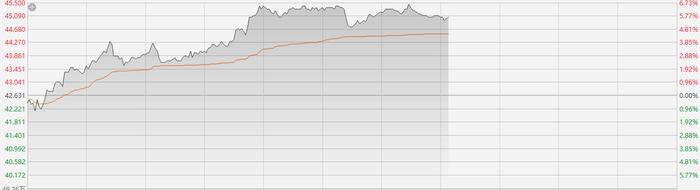

天眼查發佈2023年上半年人工智能產業投融資情況分析。從行業分佈來看,前沿技術、機器人以及集成電路的融資事件數量位居前列,自動駕駛在這三者之後,也有20起相關的融資事件。

但是,AI在大熱的同時,也在衍生出新的問題。浙江大學國際聯合商學院數字經濟與金融創新研究中心聯席主任、研究員盤和林對記者表示,目前AI監管面臨以下問題:其一,數據安全方面,利用生成式AI窺探個人隱私,甚至破壞商業機密和破壞國家安全,當AIGC掌握在不法分子手中的時候,數據安全形勢會更加嚴峻;其二,生成式AI替代就業,生成式AI會影響一部分人,另一部分人將學會使用生成式AI,但一部分人在學習新事物方面存在瓶頸,所以要平衡好生成式AI和這部分人之間的關係;其三,生成式AI 存在知識產權保護的問題,我們說AI創作繪畫的風格類似於某位畫家,但AI繪畫不曾支付版權費,這是不公平的,要在數據訓練的源頭通過數據確權來分配權益;其四,倫理問題,介於AI現在水平沒到高智慧程度,這個可能會在未來探討。

天使投資人、資深人工智能專家郭濤也認爲,當前,生成式人工智能產業還處於發展的早期階段,研發與應用的相關法律法規、標準體系和倫理規範等還不健全,存在隱私與數據保護風險、著作權侵權風險、深度僞造風險、失業加劇風險,以及歧視與偏見風險等潛在問題,制約行業長遠健康發展,迫切需要對生成式人工智能服務加強規範管理,進一步細化明確相關監管要求,完善相關法律、法規和標準體系等。

隨着問題的凸顯,各國也把對於AI的監管提上日程。斯坦福大學發佈的《2023年人工智能指數報告》中提到,對127個國家的立法記錄調研的結果顯示,包含“人工智能”的法案被通過成爲法律的數量,從2016年的僅1個增長到2022年的37個。報告對81個國家2016年以來的人工智能法律法規記錄的分析也同樣表明,全球立法程序中提及人工智能的次數增加了近6.5倍。

歐盟與美國的監管差異

美國是這場AI風暴的中心。今年3月份,數千名人工智能領域的企業家、學者、高管發出了一封題爲《暫停大型人工智能研究》的公開信,呼籲關注人工智能研發中產生的安全問題,並敦促各國政府及時介入人工智能的監管。

隨後,微軟、Adobe、IBM 、甲骨文等多家AI巨頭組成的美國科技倡導組織“商業軟件聯盟”(BSA)公開發文呼籲在國家隱私立法基礎上制定管理人工智能使用的規則。該聲明向美國國會提出了四個明確的呼籲:一是美國國會應該明確要求公司何時必須評估人工智能的設計或影響,二是美國國會應該定義何爲人工智能做出的“重大決定”,三是美國國會應該指定一個現有的聯邦機構來審查公司是否遵守了規則,四是美國國會應該要求公司爲高風險的人工智能制定風險管理計劃。

而在近日,美國衆議院網站顯示,《國家人工智能委員會法案》已被提交。根據議員們提供的法案概要,擬建立的“國家AI委員會”,將確保通過監管減輕人工智能帶來的風險和可能造成的危害,並在建立必要、長期的AI法規過程中起到主導作用。

對於美國關於AI的監管政策,百度法律研究中心主任陳晨稱:“美國通過一些行政命令強調要用一種創新的方式監管人工智能,同時保護公民的隱私和自由。但是美國也強調,要考慮如何減少人工智能技術發展創新的阻礙,美國更多的是通過‘軟法’來監管,不會用‘硬法’去強制性地干預產業發展。”

與美國還停留在“口頭呼籲”階段不同,6月14日,歐洲議會通過了一項名爲《人工智能法案》(AI Act)的法律草案,該法案將對被視爲該技術最危險的用途施加新的限制——投票禁止實時遠程生物識別技術,歐盟禁令意味着不能在公共場合實時人臉掃描;同時要求OpenAI和谷歌等公司必須進行風險評估,並披露更多用於創建程序的數據。不僅如此,《人工智能法案》將人工智能風險分爲不可接受的風險、高風險、有限的風險和極小的風險四級,對應不同的監管要求。

實際上,歐洲地區是較早將AI監管提上日程的地區。早在2018年4月,歐盟便發佈政策文件《歐盟人工智能》,提出要逐步建立適當的倫理和法律框架。2020年,《人工智能白皮書——通往卓越和信任的歐洲路徑》也指出,應構建基於風險的人工智能監管框架,通過爲不同的企業劃定風險等級避免過高的合規負擔。

對此,軒睿基金總經理蓋宏對記者表示,歐盟推動人工智能立法,有利於維護歐盟在數字主權和科技領域的領導地位,並通過立法搶佔全球人工智能監管先機。但其本身具有侷限性。相關條令並非針對特定人工智能應用領域,而是試圖把所有人工智能都納入監管範圍,整體看起來像是爲了立法而立法,執行效果或將大打折扣。

陳晨表示:“總體來看,從美國和歐盟對人工智能監管的差異可以看到,監管思路上美國更希望由市場決定,以市場爲導向,更加註重效率;歐盟採用了預防的方法,在傷害出現之前先對其進行監管,更加註重安全。”

中國:監管政策已落地

與歐美國家相比,國內在AI治理方面已走在了世界前列。

從今年4月11日,國家網信辦起草《生成式人工智能服務管理辦法(徵求意見稿)》,到7月13日,國家網信辦聯合國家發展改革委、教育部、科技部、工業和信息化部、公安部、廣電總局發佈《生成式人工智能服務管理暫行辦法》,僅僅用了3個月的時間,並且自2023年8月15日起施行。

《辦法》明確了提供和使用生成式人工智能服務的總體要求,提出國家堅持發展和安全並重、促進創新和依法治理相結合的原則,採取有效措施鼓勵生成式人工智能創新發展,對生成式人工智能服務實行包容審慎和分類分級監管。

與此同時,《辦法》做出了一系列的規範和管理措施,例如要求服務提供者需要取得相應的資質和許可,並且需要遵守一系列的技術規範和安全標準等,這些規定確保了生成式人工智能服務的合規性和安全性,保護了用戶的數據和隱私安全,可以減少人工智能帶來的不良影響;另一方面,《辦法》明確規定了生成式人工智能服務的範圍和標準,以及相關責任和義務,這些規定可以指導企業、個人和監管機構在生成式人工智能服務方面進行規範操作,避免一些可能存在的法律和道德風險。

對此,盤和林表示,《辦法》主要是從安全性角度出發,包括數據確權、數據隱私保護,以及內容上的合規性。這裏內容合規是我國獨有的需求,需要讓AIGC和自媒體採取一樣的尺度,防止非法內容傳播。

深度研究院院長張孝榮表示,《辦法》標誌着我國AI治理已經走在國際前列,生成式AI需要認真學習,打磨技術,以便維護產業健康發展,維護國家安全和社會公共利益,保護公民、法人和其他組織的合法權益。