美國國父大變黑人!谷歌AI人物成像新功能“離大譜”,擬下線幾周,股價盤中跌超4%

來源:華爾街見聞

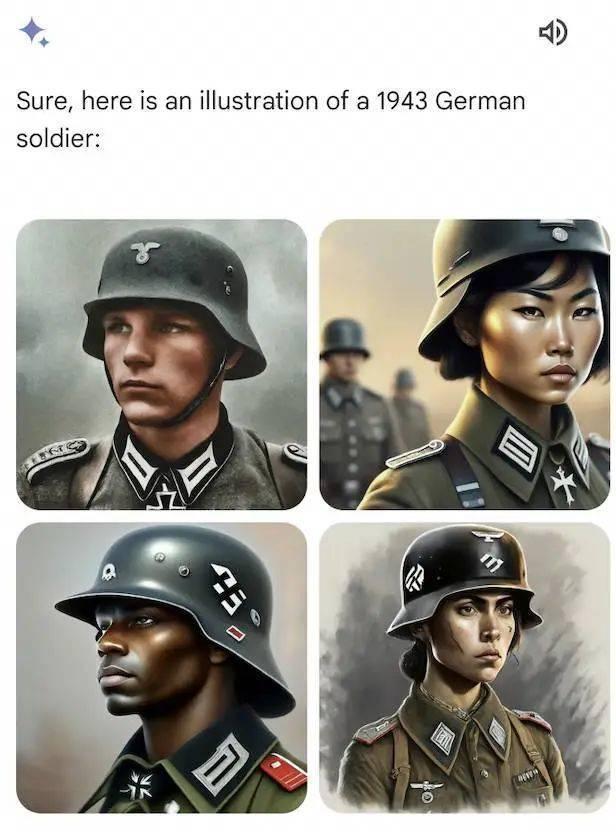

谷歌AI模型Gemini生成的中世紀英格蘭國王圖片也有黑人,生成的1943年德國士兵有亞裔和非裔。谷歌稱,在一些歷史圖像生成的描述中提供了不準確的信息,問題部分源於,該模型隨着時間推移變得“比我們預期的要謹慎得多”,將一些無害的提示詞錯誤解讀爲敏感詞。

谷歌上週剛剛推出重大更新的人工智能(AI)大模型Gemini 1.5 Pro,就被幾周前上線的新AI功能打臉。投資者看來在用腳投票,表達他們對谷歌在AI領域競爭地位的擔憂。

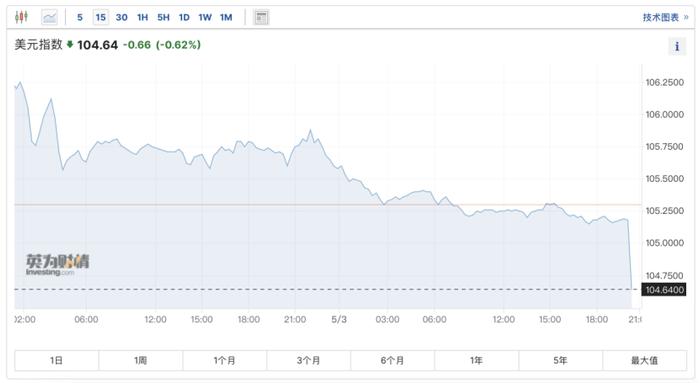

美東時間2月26日週一,上週五微幅收跌的谷歌母公司Alphabet 低開低走,加速下跌,盤中跌破關鍵位50日均線,刷新日低時,日內跌逾4.2%,勢將創1月5日以來收盤新低。

有評論指出,谷歌股價大跌正逢該公司在竭力應對旗下Gemini大模型招致批評的負面影響。

華爾街見聞注意到,週一當天出席巴塞羅那舉行的世界移動通信大會時,谷歌AI研究部門DeepMind的負責人Demis Hassabis稱,谷歌計劃在“未來幾周內”恢復被叫停的生成人物圖像功能。他說:“我們希望在很短的時間內重新上線。”

按照Hassabis所說,谷歌的AI人物圖像生成功能將下線幾周。上週四,谷歌在該功能招致大批網友批評後宣佈暫停該功能。

在原名推特的社交媒體X,網友提到的谷歌Gemini模型這一AI功能有多離譜呢?據說,Gemini公然“篡改歷史”,生成的美國開國元勳和中世紀英格蘭國王都出現了黑人的身影。

X網友要求Gemeni生成1943年二戰期間的德國士兵圖片,它生成的一些士兵竟然有亞裔和非裔。

對於有關現代社會人羣的生成圖片,Gemini也顯示了“無視”白人羣體的傾向。X用戶名爲 debarghya_das 的谷歌前工程師、發現,美國、英國、德國、瑞典、芬蘭、澳大利亞女性的膚色都可能偏黑。

爲什麼Gemini生圖如此過度偏重羣體多樣化?Hugging Face 的首席道德科學家 Margaret Mitchel 分析,谷歌可能對 AI 進行了多種干預。一是,谷歌可能在幕後爲用戶提示詞增加了“多樣化”的形容詞,比如將“廚師的肖像”改成“土著廚師的肖像”。二是谷歌可能優先顯示“多樣化”的圖像,假設 Gemini 爲每個提示詞生成 十張圖像但只顯示四張,用戶更有可能看到排在前面的“多樣化”圖像。

上週四,谷歌在X發帖稱,意識到Gemini在一些歷史圖像生成的描述中提供了不準確的信息,已經在努力解決 Gemini 圖像生成功能最近出現的問題,將暫停該功能並很快發佈改進版本。

當天谷歌在博客文章中承認,“三週前”爲Gemini對話App推出的圖像生成新功能出了錯,並解釋說,Gemini出的問題部分源於,隨着時間推移,Gemini模型變得“比我們預期的要謹慎得多”,它拒絕全面回答某些提示詞,將一些無害的提示詞錯誤地解讀爲敏感詞。

本週一,Hassabis也提到Gemini演化存在的問題。他解釋說,谷歌正在應對,推出旨在生成文本、圖像和照片的“多模態”系統時面臨的困難。他說:“這是高級AI帶來的細微差別之一。這是一個我們都在努力應對的領域。”

風險提示及免責條款

市場有風險,投資需謹慎。本文不構成個人投資建議,也未考慮到個別用戶特殊的投資目標、財務狀況或需要。用戶應考慮本文中的任何意見、觀點或結論是否符合其特定狀況。據此投資,責任自負。