國產手機大模型第一戰:購買基座大模型,拼硬件和生態

智能助理這一概念,從誕生之初就與人類對 AI 的想象密不可分,Siri 最初是作爲一個獨立的助手應用於 2010 年 2 月發佈。後來,蘋果公司於2011年4月收購了Siri,並將其集成到 iPhone 4S 中。

從那時起,Siri 成爲了蘋果設備的一個標準功能。語音助理也逐漸成爲了智能手機的標配。

隨着大模型成爲時代主流,人類再次看到讓手機聰慧如人的一縷曙光。2023年下半年開始,小米、OPPO、vivo等手機廠商紛紛宣佈入場,組建團隊,並在新系統中增加大模型能力:在連續數年的市場總量萎縮後,手機廠商寄希望於 AI 大模型,能成爲未來五年乃至更久持續吸引用戶更換手機的增長點。

出現在手機上的大模型也確實成爲了 2023 手機行業最炙手可熱的話題:到了 2024 年一月,中國手機市場 Top5 之中,除了蘋果之外,已經全數發佈了自有端側大模型產品。

從無人問津到賽道中擠滿人,只用了半年的時間。伴隨着手機廠商在發佈會中演示的包括通話記錄自動生成、AI 圖像處理等常見應用場景的整合,如今已經沒有人會懷疑大模型在手機上應用的前景,

但我們距離聰慧如人的端側大模型手機,到底還有多遠?

大模型真假自研之惑

團隊創始規模往往能說明很多問題:小米組建了超過 3000 人的 AI 團隊、vivo 也已經擁有上千人的團隊在從事生成式AI 領域的產品研發。

雖然建立了規模龐大的研發團隊,但圍繞 AI 大模型產品自研的爭議卻不曾消失:在發佈端側大模型產品時,手機廠商均會花費大量篇幅,去介紹其在 AI 領域長期以來的投入,但這實際上是在混淆語音助理背後大模型的本質。

大模型實際供應方毫無疑問是手機廠商的祕密,但從手機廠商在生成式 AI 領域的投資步伐中,還是能看出一些端倪。

據相關廠商的知情人士向記者透露:vivo 目前的大模型是在智譜 AI 的基座大模型的基礎上改進而來,小米本身也是智譜 AI 的股東,在 2023 年 10 月參與了智譜 AI 的投資;在今年四月,阿里雲峯會上,阿里雲官方發佈的‘企業專屬大模型’合作名單裏,OPPO 位列第一。

這位行業人士同時還向記者透露:手機廠商在購買基座模型的投資均耗資數千萬,讓以語音助理面貌呈現給普通用戶的大模型產品最終能夠適應硬件的結構,給出及格線以上的大模型體驗。

對於這些廠商來講,目前自研大模型暫時無法滿足用戶對大模型能力的需求,因此主要的選擇是從市面上購買現成的預訓練模型,在此基礎上進行調整。加上發佈時的營銷手段,買來的預訓練模型在不經意間變成了“自研”。

此外,由於現行《生成式大模型管理服務暫行辦法》帶來的額監管白名單制的存在,手機廠商想要趕上這一波熱潮,購買現有基座大模型在其基礎上進行微調而來的“自研”,對當下來講是短平快的方案,也是“搶首發”是爲數不多的選擇。

但這種先發優勢在註定會是一場馬拉松的端側大模型競爭中,能在多大程度上後續得到保留讓人懷疑。

硬件天花板在哪?

目前在手機廠商公佈的多模態大模型方案中,端側大模型都屬於多種體積中最低的一檔,參數數量往往只有最頂級的百分之一。實際運行效果自然不可同日而語。

但端側大模型的存在價值毋庸置疑,它是爲了解決雲端大模型誕生以來就有的種種問題,用戶的每次對雲端服務器的請求都會產生一定的成本,同時也是解決用戶數據隱私問題的根本辦法。

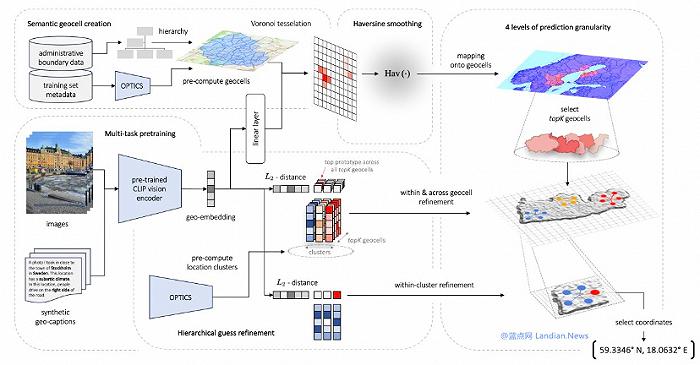

大模型技術的突飛猛進不僅便利了我們的生活,也讓隱私暴露的風險空前巨大:斯坦福大學的一組研究人員近期發佈了一個利用 10 萬個隨機位置以及 50 萬張街景圖片訓練出的大模型,能夠從照片信息中快速識別出拍攝者當前的所處的位置,準確率達到了 92%。

當前不同手機廠商的策略之間略有不同,但端側大模型是任何廠商都無法避開的必選項:完全在端側運行的大模型在未來會變得更加重要。

解決了技術路線問題,剩下的主要問題就變成了硬件:70 億參數級別是當前一個“甜點級”關鍵節點,70 億參數大模型正常的模型大小在 28GB 左右,爲了真正在端側部署,對模型進行壓縮和輕量化如今已經能將其壓縮至 3.9GB 左右,無論是存儲還是內存佔用都是這個量級。

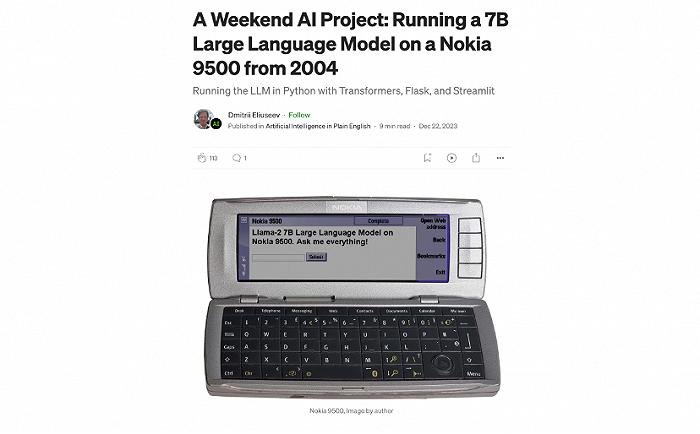

但在精簡模型體積、增加運行效能的道路上還有很大的提升空間:目前開發者甚至能在 2004 年發佈的諾基亞 9500 的硬件上,運行起來一個 70 億參數大小的本地大模型。

A Weekend AI Project: Running a 7B Large Language Model on a Nokia 9500 from 2004

這一方面反映出端側大模型在過去一年正在以驚人的速度發展迭代的事實,一方面爲 AI 專用設計的硬件,能夠在當前水平下極大提高 AI 大模型運行速度上限。如今搭載 TPU 的 Google Tensor 系列處理器已經在離線環境下實現每秒 20 個 token 的處理速度,相比之下桌面端的 MacBook Air M2 僅爲 5 token 每秒。

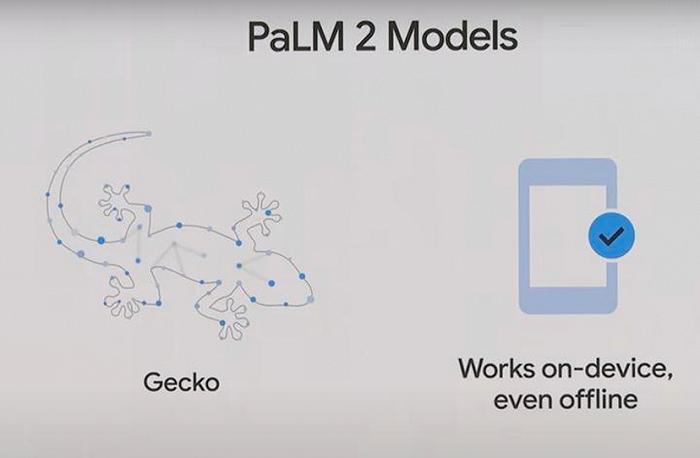

移動端獲得反超桌面端的 token 處理速度,這得益於硬件在設計之初便考慮到深度學習:如 Google 與三星聯合定製的Tensor 系列 SoC,內部已經集成了用於人工智能加速器專用集成電路(ASIC),讓其擁有了其他廠商巨大的優勢:這種優勢不僅會體現在 2023 的端側大模型首發浪潮,更會在後續的競爭中體現的更加明顯。

高通也通過多年的佈局,在硬件上形成了類似的生態,最新發布的高通驍龍 8 Gen 3 SoC 芯片已經支持在端側離線運行 100 億參數(10B)級別的大模型,並已經展示了在手機端側運行 LLaMA2 的能力。

端側大模型的天花板目前主要體現在對手機運行內存的壓力上,這是當前階段手機廠商普遍只選擇旗艦手機測試端側大模型的直接原因。因此除了硬件的專用設計,對模型本身的效能優化也依賴於對模型的迭代,這需要雲計算業務提供的海量算力支撐。

端側大模型強調的‘利用手機閒置算力、保障用戶數據安全’的前景看似誘人,但現階段卻並非能夠支撐起足夠用戶體驗的解決方案,其定位更多是現階段雲端大模型的補充。會隨着端側大模型能力的增長很快見到新的變化。

無論是華爲、谷歌,還是尚未入局的蘋果,在過去的芯片設計中都已經有針對 AI 的專用算力進行適配,尤其是此前已經存在數年的 NPU,直接決定着端側 AI 的聰慧程度,谷歌、華爲都有針對自研芯片中的 AI 算力進行大量的能效優化,這直接考驗着手機廠商對硬件的掌控能力。

生態挑戰

以現有的語音助理形態爲基礎,將端側/雲端大模型的交互入口整合其中,是目前門檻最低、相對實現效果最好手機 AI 大模型交互方式。

低門檻同時也意味着更多強有力競爭對手的湧入:幾乎沒人願意放棄接管手機智能助理的可能性,據 Android Authority 報道,ChatGPT 在近期更新中已經加入了能在桌面,讓用戶可以在系統中將 ChatGPT 設置爲手機的默認語音助理,直接調用 ChatGPT-4 的語音交互能力。

但手機硬件廠商也有自己的優勢:用大模型能力,讓手機現有硬件第一方能力再進一步,幾乎是目前所有玩家的共同選擇。

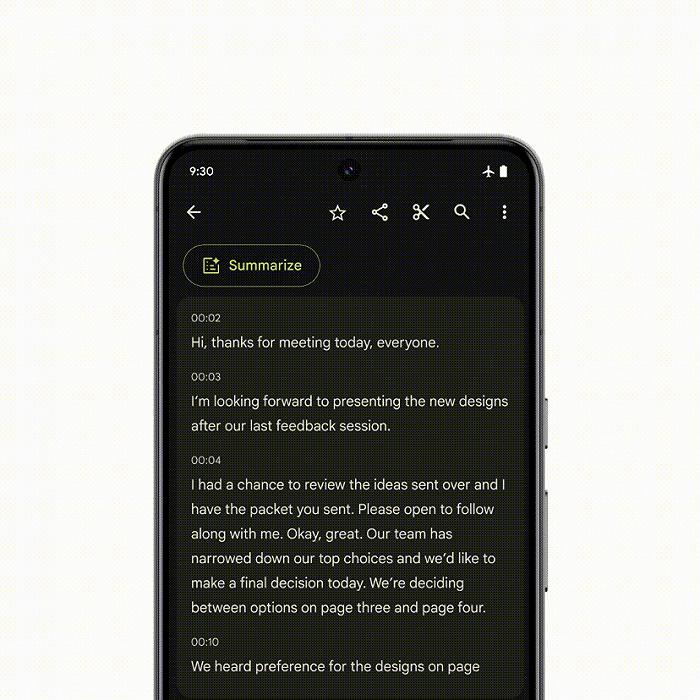

去年 11 月,Google 在首次對外公開 Gemini 時,爲了更好地展示其在端側的應用場景,在 Android 14 自帶的錄音機App 以及 Gboard 英文輸入法都進行了整合。讓錄音語音轉文字速度更快同時提高準確率。

關聯閱讀:《Google 剛發佈的 AI 模型 Gemini,這些特點值得關注》

國產手機廠商目前的發佈中,端側模型應用也已經能在諸如本地圖像識別、處理,以及通話記錄等領域展現出驚人的能力,因爲這些概念對於手機廠商並不陌生,在 AI 模型概念廣爲人知之前,手機端側已經有諸多 AI 以及深度學習技術的應用場景:從手機計算攝影到後臺內存調度,小到桌面交互動畫,都有 AI 技術的影子。

但更具有想象力的應用場景仍是第三方應用生態:智能語音助手本身就有打通應用層級、幫助直接觸及某一具體功能的‘捷徑’作用,例如打通日曆、支付以及訂票 App,幫用戶一鍵訂高鐵/飛機票。但這樣夢幻的場景對於端側大模型來似乎觸手可及,但實現起來還有更多阻礙。

長期以來,手機廠商對用戶並不會用語言助手的事實心知肚明:在 OPPO 發佈安第斯 GPT 之後,表示‘不做大模型的手機企業就沒戲了’的 OPPO 首席產品官劉作虎,曾幾何時也在接受媒體採訪時表示‘並沒有多少用戶真的在用智能助理’。

語音助手長期偏“低能”的現實,讓即使常年投資 AI 領域的智能手機廠商也有意無意地忽視了構建生態的重要性。對於開發生態的投入遠遠落後於硬件以及生成式 AI 行業的發展腳步。即使 2023 年小米、華爲、vivo、OPPO 先後都面向開發者發佈了適配端側大模型的開發規範,但如何快速整合更多應用服務加入自有生態中仍然缺乏行之有效的解決方案。

類似妙鴨相機這樣獨立生成式 AI 應用的爆火,也在鼓勵着更多第三方應用甚至獨立開發者加入這場手機大模型競爭,但這更多是“各自爲戰”,沒有足夠的利益驅動,手機廠商很難將這些第三方 App 高效地整合進自有大模型產品中。

‘實際上,正是因爲大模型有着真正顛覆體驗的潛力,才讓原本存在多年、根深蒂固的問題暴露了出來’某手機大模型產品經理對記者表示。

想要解決這個問題,手機操作系統中如同“超級膠水”一般的通用接口,將會是未來大模型生態中如同“基礎設施”一般的存在:隨着 Gemini 的發佈,Google 也在 Android 14 中一道整合了 API ,供開發者自由適配自己的 App,來調用本地的 Gemini 能力。未來也會有更加通用,適合所有端側大模型的 API 開發接口的問世。

但這樣的更新嚴重依賴 Google,在這一點上會受制於 Android 官方的更新步伐。‘業內缺少統一的開發接口會成爲未來一段時間內的必然事件,因此有硬件與生態的廠商,後發優勢會更加明顯’。大模型產品經理這樣看待未來端側大模型生態的狀態。

歸根結底,大模型概念在手機中最終落地,與應用生態的深度整合幾乎是避無可避的問題。生成式 AI 能在多大程度上真正接管手機的日常使用同樣有賴於此,這將是位處生態鏈下游的手機廠商與開發者更能展開競爭與合作的新戰場。

現在判斷誰是贏家爲時尚早,但手機毫無疑問是當下最適合大模型生長的終端設備之一。大家期待的端側大模型帶來下一個“iPhone 時刻”,最終更有可能在已經擁有完整大模型開發能力、芯片設計。製造能力,以及生態號召力的廠商中誕生。

手機廠商在端側大模型的第一回合已經結束,手機端側大模型走向臺前,但真正的主導者尚未出現。只有當 AI 大模型真正成爲智能手機‘質變’的時刻出現,用戶自然樂於爲更好的體驗買單。