特斯拉Autopilot撞人致死,車主被按“殺人罪”起訴,特斯拉出庭作證

歡迎關注“新浪科技”的微信訂閱號:techsina

文/賈浩楠

來源:智能車參考(ID:AI4Auto)

特斯拉司機被控“殺人”,並出庭受審,這是全球首例。

重點是:這場導致兩人死亡的嚴重事故發生時,車上的Autopilot處於開啓狀態。

特斯拉自稱的完全自動駕駛出事不是一兩次,但這一次司法部門認爲:錯在駕駛員,與Autopilot無關。

史無前例的審判,加上馬斯克於此時親自領導成立特斯拉訴訟部門,讓爭議更加尖銳:

自動駕駛相關事故,系統提供方到底需不需要負責?法律天平是不是更容易向企業傾斜?

車主因“殺人”受審,特斯拉出庭作證

洛杉磯縣法院起訴這名車主的罪名是:駕車殺人 (vehicular manslaughter)。

國內沒有類似罪名,在美國也是近幾年纔出現的。

根據定義,駕車殺人罪是指“因重大過失、酒後駕車、魯莽駕駛或超速等非法駕駛汽車行爲而造成人員死亡的犯罪。”

理論上說,因爲涉及人命,所以這是一種嚴重的刑事犯罪。

但實際情況是判罰有輕有重,比如只有輕微超速致人死亡的,通常最多隻判1年監禁,但如果司機處於醉駕或毒駕狀態,刑罰會嚴重得多。

其實這項罪名的提出,是爲了替代之前美國交通事故判決中常用的過失殺人罪,立法機構認爲相關刑罰太重,用在交通肇事案件中對被告不公平。

美國的法律是否合理我們不討論。但從這項罪名描述來看,提起相關訴訟必須得有證據表明司機在駕駛過程中存在重大過失。

而洛杉磯法院說:已經有足夠的證據表明這名特斯拉駕駛員犯駕車殺人罪。

本案審理剛剛開始,所以這些證據並未公開,不過可以從事故情況中分析。

2019年12月29日,Kevin George Aziz Riad駕駛特斯拉Model S,經由高速進入洛杉磯加迪納市,此時已處於超速狀態。

緊接着,這輛特斯拉以119公里的時速闖過一個加迪納市區的紅燈,然後在十字路口撞上了一輛本田思域,直接導致思域車內兩名乘客死亡。

特斯拉車內的兩人也受傷,不過沒有生命危險。

而在事故發生時,Autopilot處於開啓狀態。

按照2019年底Autopilot版本的能力,並不能識別紅綠燈並自主應對。

所以司法機關起訴的理由,是司機沒有對Autopilot實施有效監管,從而導致事故發生。

而特斯拉也派出工程師出庭作證,說事發時車輛的確開啓了Autopilot,並且司機雙手也在方向盤上,但事故發生前的6分鐘內,車輛沒有任何剎車減速動作。

這相當於坐實了“過失”的指控,殺人誅心。

畢竟在多次事故後特斯拉已經改口不說“完全自動駕駛”,而是強調無論Autopilot或FSD都需要駕駛員隨時準備接管。

至於爲什麼車輛從高速下來後不減速還闖紅燈,並且司機一次剎車的行爲都沒有,仍然是個謎團。

有外國網友分析認爲,可能是高速階段司機開啓了NOA,但下高速後系統自動轉到不能識別紅綠燈的Autopilot,而司機並未對自動駕駛狀態改變有所察覺。

速度問題並不奇怪,特斯拉NOA通過匝道上高速後不加速、下高速後又不會自動減速的現象,早被國內外車主吐槽無數遍了。

這次的事故,有可能有這樣的原因。

不過,特斯拉因爲提前打過“預防針”,現在有充分理由將責任轉嫁。

而司法機關也認爲駕駛員“沒看管好”特斯拉Autopilot屬於重大過失,是事故的根本原因,至於Autopilot技術成熟與否跟事故沒有直接關係。

一旦罪名成立,Kevin George Aziz Riad就會成爲史上第一個在自動駕駛事故中承擔全責的人類駕駛員,這個案子可能也會對自動駕駛發展產生重大影響。

“司機殺人”有啥影響?

自動駕駛出事,系統提供方要不要承擔責任是一個社會層面的難題。

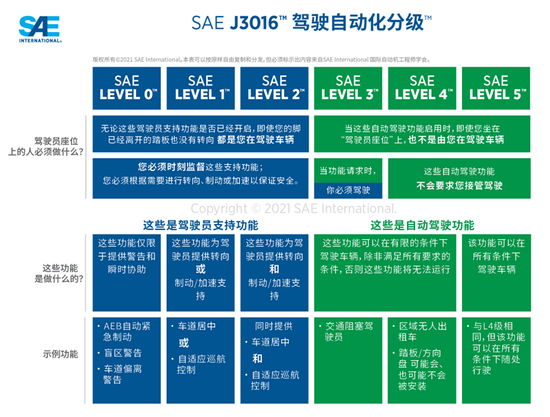

核心原因在於,現階段L2+、L3級別的自動駕駛,做不到100%的無人和可靠。

L2+、L3可以在特定情況下實現自動駕駛,有的甚至允許駕駛員的視線離開道路,只有當車輛提示需要接管時,駕駛員再進行接管。

可以看出L3處在一個尷尬的地位,既與常規輔駕級有根本區別,又達不到L4的可靠性。

說它絕對可靠,卻仍然不能離開人的干預;說它不可靠,但實際L3相關技術已經能解放大部分人力勞動。

從2017年至今,沒有一個國家監管機構出臺明確的L3審批明細,也是因爲類似特斯拉Autopilot和FSD這樣的自動駕駛,難以量化人爲接管的時機和條件。

所以現階段所有在路上跑的L2+以上的汽車,其實都處在一個路權模糊的階段,人類駕駛員和AI司機的權責劃分無據可依。

這也造成了過去幾年中混亂的事故處理方式。

歐洲偏向保守,不允許特斯拉或其他自動駕駛公司自誇“無人”,判決中也傾向用戶的生命財產安全。

北美則更激進,幾次嚴重事故,最終歸因到人類司機身上,比如著名的Uber自動駕駛致死案,以及現在的這起案件。

國內也出現過多起類似事故,只不過國內廠商更爲低調,處理方式以庭外賠償爲主。不過在低速無人配送車領域,出現了權責判罰完全不同的案例,比如我們之前介紹過的美團無人車事故。

到底應該是廠商負責,還是用戶負責,現在沒人能給出答案。

前不久奔馳放出豪言說L3出事故廠家負全責,讓業界和用戶眼前一亮。

不過仔細一看,奔馳給L3限定了嚴格的使用條件,天氣、路段、速度等等,一條不符合,奔馳就可以不承擔責任。而符合條件的場景,日常使用中寥寥無幾。

所以奔馳的承諾,擺姿態作秀意義遠大於實際,於技術於法律,沒有起到任何推動作用,哪怕能引起的有意義的討論都不多。

但這次的案件不同。在遵循判例法的美國,一旦特斯拉此案塵埃落定,車主要爲“駕車殺人罪”負全責,那麼對於行業影響是重大的。

無論這一步是前進還是後退,以後的類似自動駕駛事故,有了判例可依。

傾向於用戶承擔責任,自動駕駛提供方毫無疑問會更加放開手腳上馬量產自己的新技術,在功能和安全保障上可能也會走得更激進。

因爲,對於特斯拉這樣的公司來說,打官司損失的錢不足爲道,重要的是一旦法律判決它要爲技術缺陷買單,損害的是投資人的信心、公司的聲譽,進而影響公司運營和技術迭代。

而從這次這起案件的司法判決傾向來看,對特斯拉無疑是大大有利的:用戶義務爲廠家提供免費路測數據,出了事還得自己負責。

有人形象的比喻:L4以下的自動駕駛競爭,好比擠滿了你追我趕運動員的賽道,但遺憾的是,這個比賽的規則根本沒制定好,跑得快不代表跑得贏;

更遺憾的是,對於觀望比賽的購車用車的普通人來說,不管誰跑贏,你可能都不敢上車一起跑。

One more thing

加州司法機構起訴特斯拉駕駛員駕車殺人罪的同時,特斯拉這裏也有了新動作。

特斯拉在公司內部成立了專門應對法律訴訟的部門,既包括被動應訴,也包括主動起訴。

馬斯克透露,這個新部門很“硬核”,直接向他彙報。

的確耐人尋味。

是之前官司纏身不堪其擾的自保之策,還是看到了司法風向變化,認爲自己能拿到“免死金牌”?